AI:s exponentiella språng: Vad de närmaste åren kan innebära

Det är svårt att sia, särskilt om framtiden

Citatet har tillskrivits en rad olika personer — bland annat Niels Bohr och Nostradamus — och är lika tillämpligt på allt från börsens svängningar till AI:s kapacitet.

I det här blogginlägget tänker jag försöka förklara vad jag tror kommer hända inom AI de närmaste åren, och varför jag tror det. Även om det onekligen är svårt. Men låt oss ta det från början.

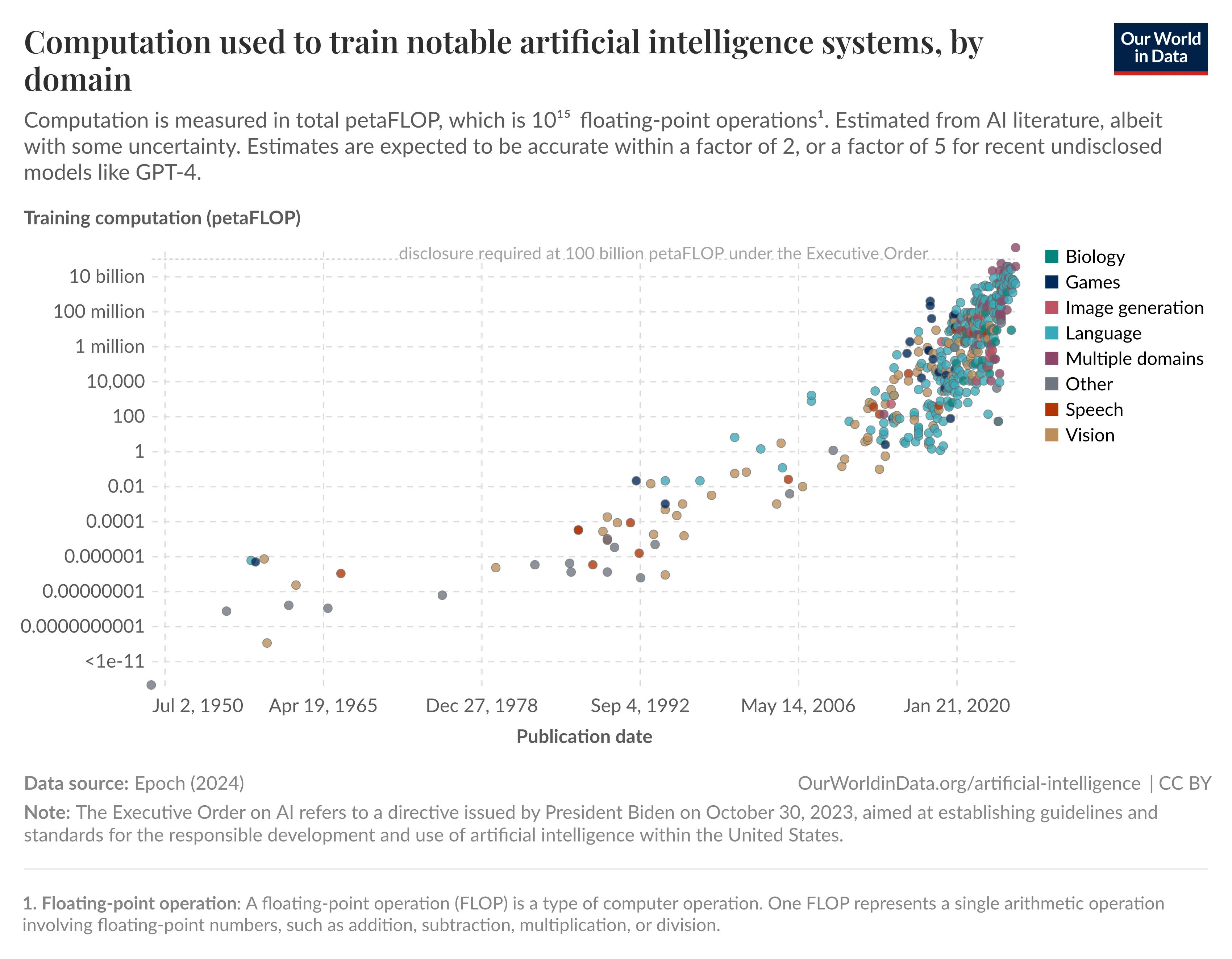

Rötterna till modern AI-forskning kan spåras tillbaka till Dartmouth-workshopen 1956 (där begreppet “Artificial Intelligence” myntades). Sedan dess har ett spår inom AI-forskningen handlat om att träna allt större neurala nätverk. (Stora språkmodeller, LLM:er, är en specifik typ av neurala nätverk.) Ett mått på storleken på dessa nätverk är antalet FLOP (flyttalsoperationer) som krävs för att träna dem.

Det är tydligt att modellerna växer exponentiellt — men leder ökad storlek faktiskt till ökad kompetens?

Min nuvarande bild baseras främst på två datakällor: Our World in Datas analys “Test scores of AI systems on various capabilities relative to human performance” och en rapport från Metr med titeln “Measuring AI Ability to Complete Long Tasks”.

Låt oss titta på vardera.

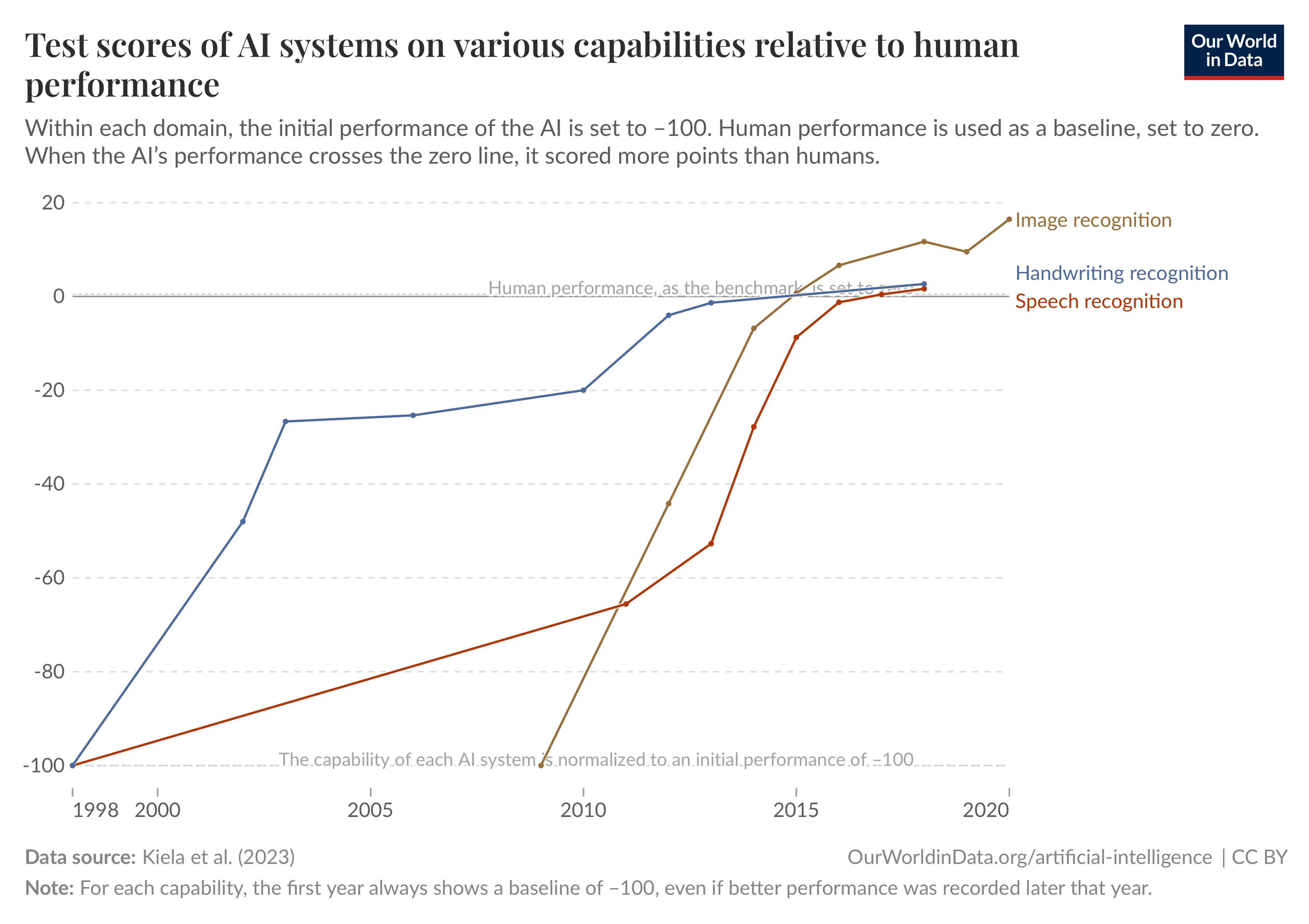

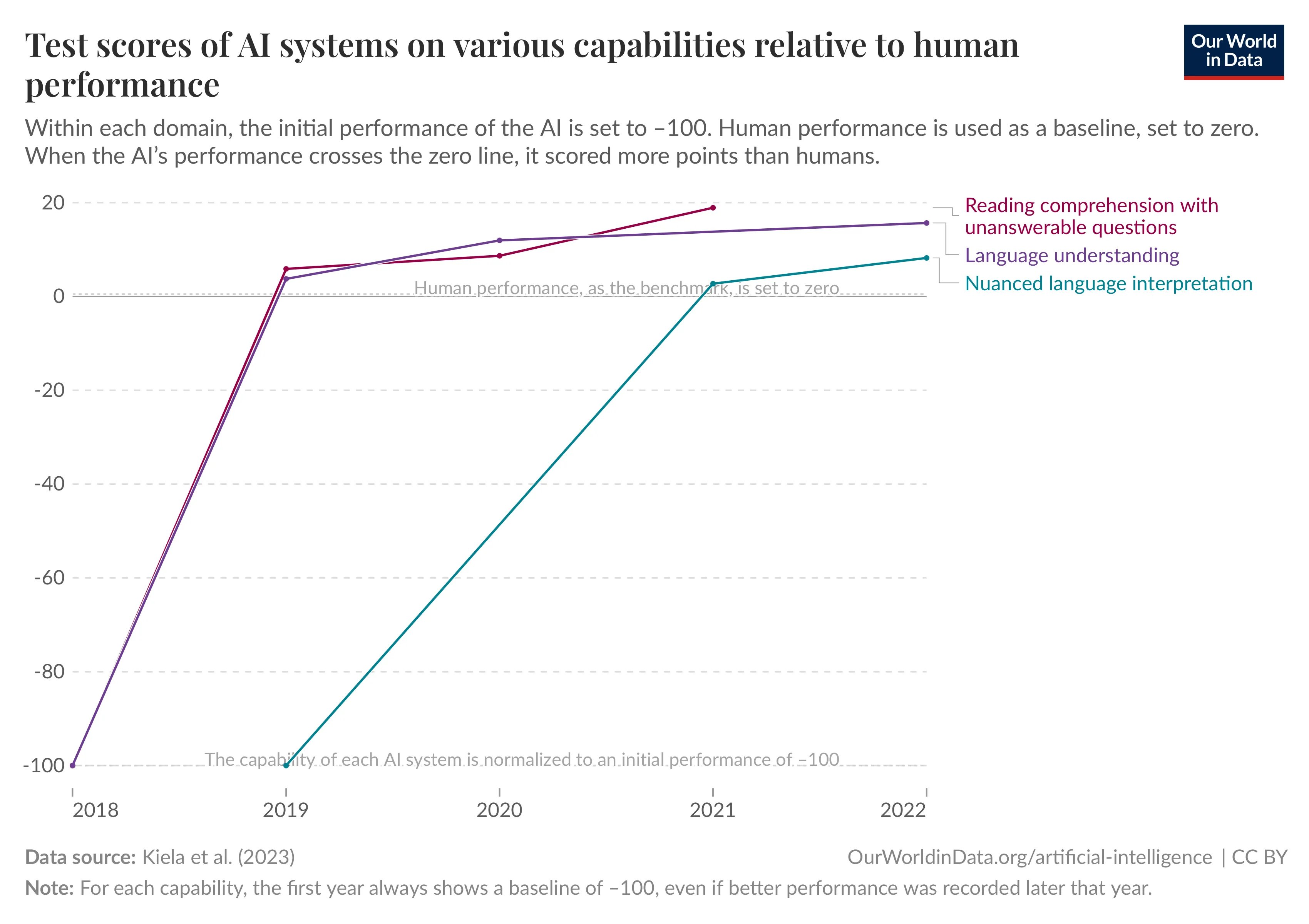

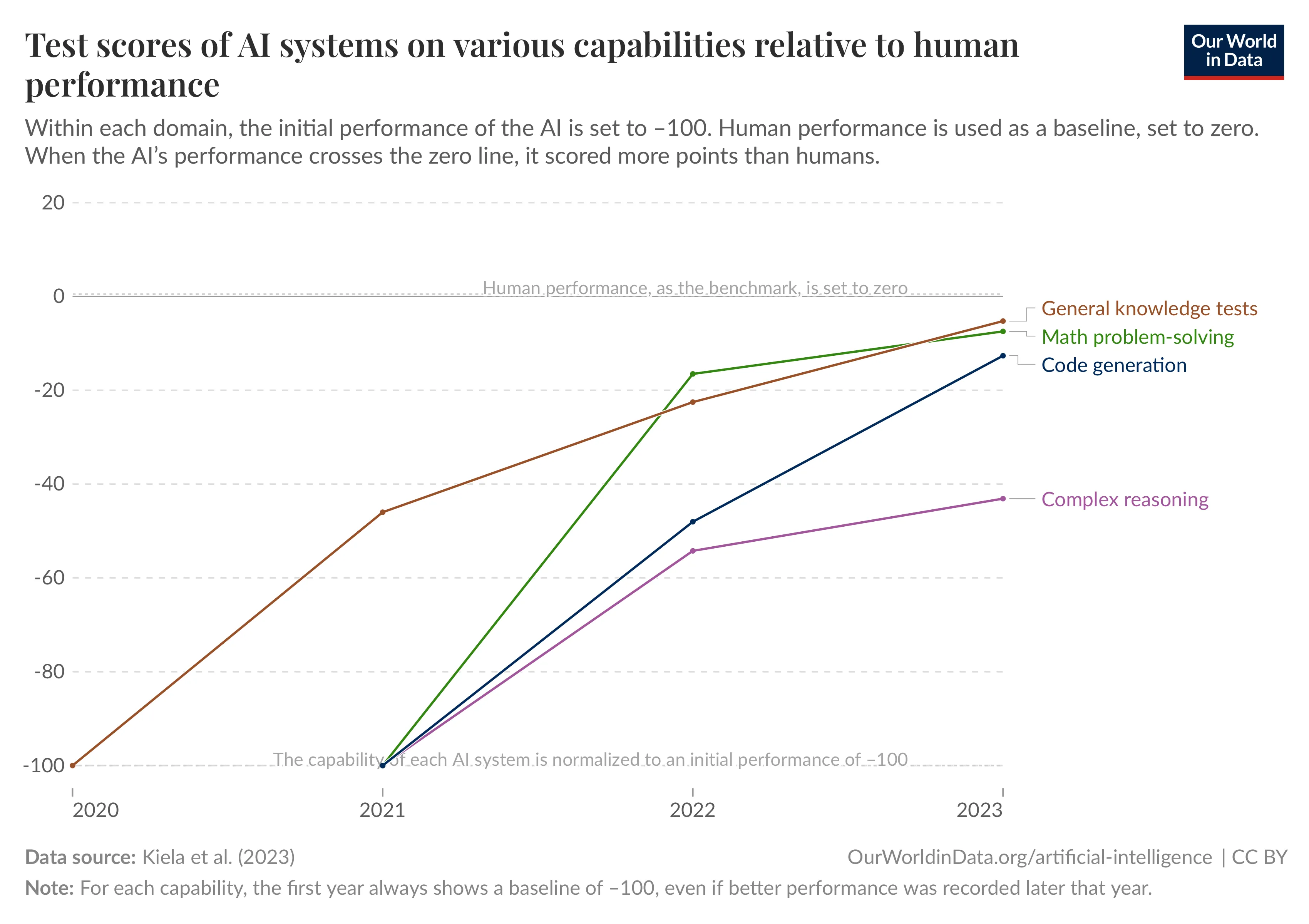

Analysen från Our World in Data illustrerar hur AI:s prestationer på olika benchmarks har utvecklats över tid, jämfört med en mänsklig baslinje (satt till 0), där en helt inkompetent AI får värdet -100. Jag noterar att benchmarks kan delas in i tre kategorier:

-

Sådant som var “löst” redan innan transformerarkitekturen uppfanns (den arkitektur som moderna LLM:er bygger på)

-

Sådant som “löstes” snabbt efter att transformerarkitekturen uppfanns

-

Sådant som ännu inte var “löst” (vid publiceringstillfället, 2023)

Jag använder “löst” i betydelsen “enligt ett benchmark presterar AI-system bättre än människor på just den uppgiften”.

Vi kan se att förmågor som mättes redan innan transformerarkitekturen gick från -100 (oanvändbara) till 0 (jämförbara med mänsklig prestation) under en period på 7–20 år.

Efter att transformerarkitekturen uppfanns (2017) ser vi plötsligt att vissa förmågor “löses” på bara ett eller två år (främst mätningar kopplade till språkförståelse — något som LLM:er utmärker sig i).

I slutet av 2023 förbättrades ett antal värdefulla förmågor snabbt, men hade ännu inte nått mänsklig nivå. En uppdatering av analysen är planerad till maj 2025, och den kommer med all sannolikhet att spegla de betydande framsteg som gjorts inom allmänkunskapsprov, matematisk problemlösning och kodgenerering.

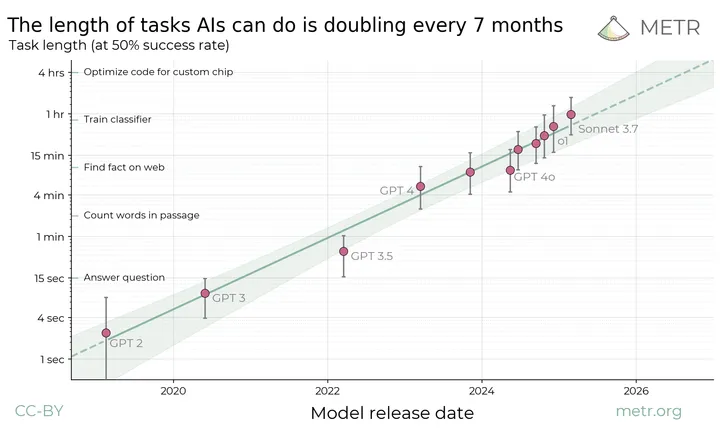

Att korrekt besvara enskilda frågor är imponerande, men att lösa verkliga problem kräver ofta att man tillförlitligt utför flera uppgifter i sekvens under längre tid. Den träffande titeln på Metrs rapport, “Measuring AI Ability to Complete Long Tasks,” handlar just om att mäta hur väl AI-system presterar på sådana utsträckta uppgifter.

Metr definierar uppgiftens längd som den tid en professionell människa skulle behöva för att slutföra den. Enligt rapporten följer AI:s förmåga att hantera uppgifter — mätt i motsvarande mänsklig tidsåtgång — en skalningslag som fördubblas ungefär var sjunde månad.

Äldre modeller, som GPT-2, klarade bara uppgifter som en professionell människa skulle slutföra på sekunder. GPT-2 kunde till exempel tillförlitligt producera en grammatiskt korrekt mening, men hade svårt att sätta ihop flera meningar till en sammanhängande berättelse. De senaste toppmodellerna klarar uppgifter som skulle ta en människa en timme att slutföra (exempelvis att skriva längre kodavsnitt, eller att utföra flerstegssökningar på internet och kombinera resultaten).

Om denna empiriska skalningslag håller i sig kommer AI-system att tillförlitligt kunna hantera uppgifter som motsvarar en månads arbete för en människa inom bara några år.

Kombinera den prognosen (en månads arbete utfört tillförlitligt med en enkel prompt) med hur förmågorna utvecklas inom flera domäner (språk, kodning, matematik och komplext resonemang), och vi bör förvänta oss att AI kan automatisera en rad ekonomiskt värdefulla delar av samhällsekonomin.

Är scenariot som beskrivs i AI 2027 kanske inte så orimligt?

“Vi förutspår att effekten av övermänsklig AI under det kommande decenniet kommer att vara enorm, och överträffa den industriella revolutionens.”